المحتوى

المصدر: Kran77 / Dreamstime.com

يبعد:

تقوم نماذج التعلم العميق بتدريس أجهزة الكمبيوتر للتفكير من تلقاء نفسها ، مع بعض النتائج الممتعة والممتعة للغاية.

يتم تطبيق التعلم العميق على المزيد والمزيد من المجالات والصناعات. من السيارات بدون سائق إلى تشغيل Go إلى إنشاء موسيقى صور ، هناك نماذج جديدة للتعلم العميق تخرج كل يوم. هنا نذهب إلى أكثر من نماذج التعلم العميق شعبية. يأخذ العلماء والمطورون هذه النماذج ويقومون بتعديلها بطرق جديدة ومبتكرة. نأمل أن تلهمك هذه الواجهة لمعرفة ما هو ممكن. (لمعرفة المزيد عن التطورات في الذكاء الاصطناعي ، راجع هل ستكون أجهزة الكمبيوتر قادرة على تقليد الدماغ البشري؟)

النمط العصبي

لا يمكنك تحسين مهارات البرمجة لديك عندما لا يهتم أحد بجودة البرنامج.

حكوات العصبية

Neural Storyteller هو نموذج يمكن ، عند إعطاء صورة ، إنشاء قصة رومانسية حول الصورة. إنها لعبة ممتعة ومع ذلك يمكنك أن تتخيل المستقبل وترى الاتجاه الذي تتحرك به جميع نماذج الذكاء الاصطناعي هذه.

الوظيفة المذكورة أعلاه هي عملية "تبديل النمط" التي تسمح للطراز بنقل التعليقات التوضيحية للصورة القياسية إلى نمط القصص من الروايات. استلهم تحول الأسلوب من "خوارزمية عصبية للأسلوب الفني".

البيانات

هناك مصدران رئيسيان للبيانات المستخدمة في هذا النموذج. MSCOCO عبارة عن مجموعة بيانات من Microsoft تحتوي على حوالي 300000 صورة ، تحتوي كل صورة على خمسة تعليقات. MSCOCO هي البيانات الخاضعة للإشراف الوحيدة المستخدمة ، وهذا يعني أنها البيانات الوحيدة التي يجب على البشر الدخول فيها وكتابة التعليقات التوضيحية بشكل صريح لكل صورة.

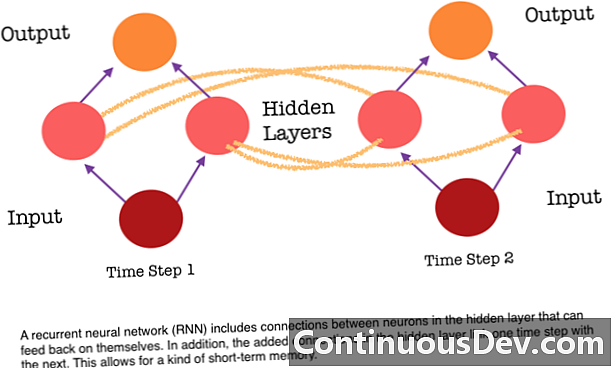

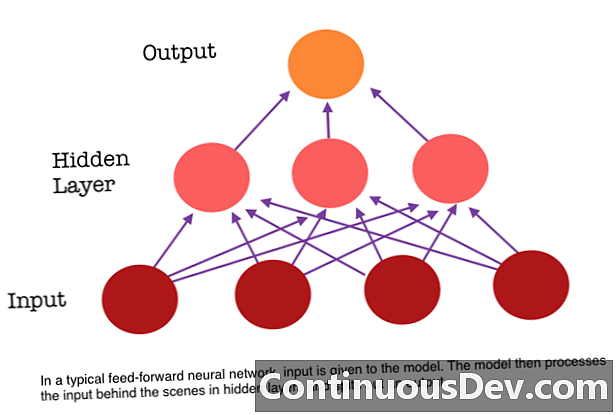

واحدة من القيود الرئيسية لشبكة العصبية تغذية إلى الأمام هو أنه لا يوجد لديه ذاكرة. كل التنبؤ مستقل عن الحسابات السابقة ، كما لو كان التنبؤ الأول والوحيد الذي قامت به الشبكة على الإطلاق. ولكن بالنسبة للعديد من المهام ، مثل ترجمة جملة أو فقرة ، يجب أن تتكون المدخلات من بيانات متسلسلة وذات صلة متزامنة. على سبيل المثال ، سيكون من الصعب فهم كلمة واحدة في الجملة دون أن يخدع الكلمات المحيطة بها.

RNNs مختلفة لأنها تضيف مجموعة أخرى من الاتصالات بين الخلايا العصبية. تسمح هذه الروابط للتنشيطات من الخلايا العصبية في طبقة مخفية بالتغذية مرة أخرى على نفسها في الخطوة التالية في التسلسل. بمعنى آخر ، في كل خطوة ، تتلقى الطبقة المخفية كل من التنشيط من الطبقة تحتها وأيضًا من الخطوة السابقة في التسلسل. هذا الهيكل يعطي أساسا ذاكرة الشبكات العصبية المتكررة. لذلك لمهمة اكتشاف الأشياء ، يمكن أن تعتمد RNN على تصنيفاتها السابقة للكلاب للمساعدة في تحديد ما إذا كانت الصورة الحالية كلب.

Char-RNN TED

يسمح هذا الهيكل المرن في الطبقة المخفية بأن تكون شبكات RNN جيدة جدًا لنماذج اللغة على مستوى الحرف. Char RNN ، تم إنشاؤه في الأصل بواسطة Andrej Karpathy ، هو نموذج يأخذ ملفًا واحدًا كمدخلات ويدرب RNN على تعلم التنبؤ بالحرف التالي في تسلسل. يمكن لشبكة RNN توليد حرف بحرف يبدو كبيانات التدريب الأصلية. تم تدريب العرض التوضيحي باستخدام محاضر محادثات TED المختلفة. قم بإطعام النموذج بواحد أو عدة كلمات رئيسية ، وسيؤدي ذلك إلى إنشاء مقطع حول الكلمة (الكلمات) الرئيسية في الصوت / النمط الخاص بـ TED Talk.

خاتمة

تُظهر هذه النماذج طفرات جديدة في ذكاء الماكينة التي أصبحت ممكنة بسبب التعلم العميق. يُظهر التعلُّم العميق أنه يمكننا حل المشكلات التي لم نتمكن من حلها من قبل ، ولم نصل بعد إلى هذه الهضبة. نتوقع أن نرى أشياء أكثر إثارة مثل السيارات بدون سائق على مدى العامين المقبلين نتيجة للابتكار في التعلم العميق.